❓ FAQ (Preguntas frecuentes)

¿Qué es exactamente MLOps y LLMOps y por qué lo necesita mi empresa?

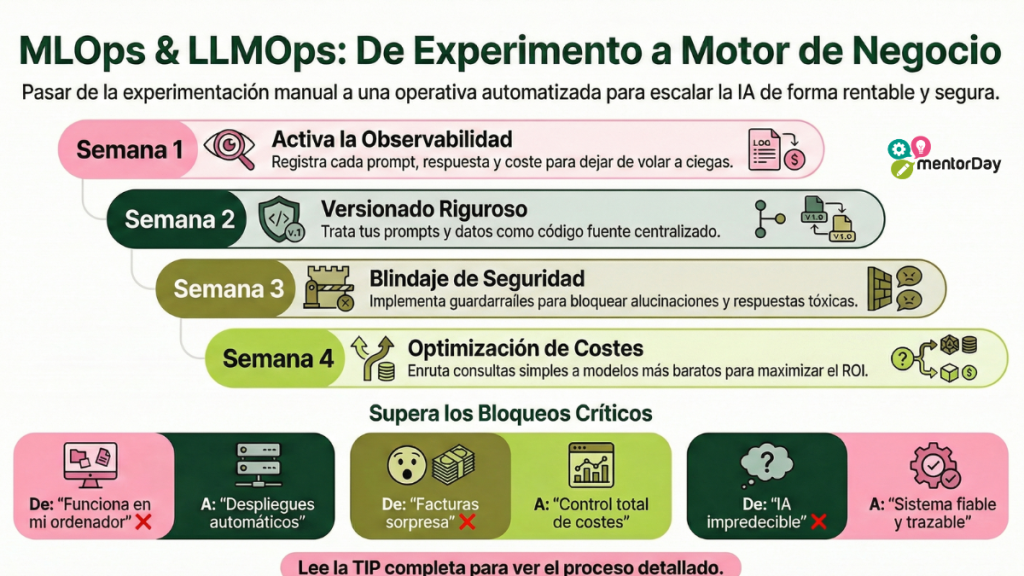

Es el puente operativo que transforma tus experimentos básicos con Inteligencia Artificial en un sistema real, seguro y rentable en producción. Su función principal es garantizar que tu modelo de IA responda rápido, controle sus costes diarios y no invente información frente al usuario. Sin esta estructura técnica, la IA es simplemente un experimento caro; al implementarla de forma correcta, la conviertes en un motor de negocio escalable

¿Cómo evito que mi Inteligencia Artificial alucine o dé malas respuestas a los clientes?

La solución más efectiva es implementar «guardarraíles» o filtros de seguridad por diseño. Debes configurar validadores automatizados en las salidas de tu IA que analicen y bloqueen contenidos tóxicos o inventados antes de que lleguen al cliente final. Además, automatizar la actualización de tu base de conocimiento permite que el sistema contraste la información en tiempo real, reduciendo drásticamente las alucinaciones.

Los costes de usar herramientas de IA se disparan al conseguir más usuarios, ¿cómo los reduzco?

La acción clave es aplicar una estrategia de enrutamiento inteligente para optimizar tus costes operativos. Consiste en identificar las consultas más sencillas de tus usuarios y dirigirlas hacia modelos de lenguaje más pequeños, rápidos y baratos. De este modo, reservas el uso de los modelos más potentes y caros exclusivamente para resolver problemas de razonamiento complejo, protegiendo así tu margen de beneficio.

¿Cuándo es el momento crítico para empezar a aplicar esta disciplina en mi negocio?

Debes integrarlo obligatoriamente cuando te encuentras en fase de crecimiento y la Inteligencia Artificial es el núcleo tecnológico de tu propuesta de valor. Las señales de alarma para actuar de inmediato son: el sistema responde muy lento, los costes de uso se comen tu rentabilidad o la calidad de las respuestas se degrada sin motivo aparente. Por el contrario, no es prioritario si tu empresa está en fase de ideación intentando validar ventas de forma manual.

Tu Próximo Gran Paso: Acelera con mentorDay

Ahora que conoces el método, es momento de llevarlo a la práctica con el acompañamiento de expertos. Inscríbete gratuitamente al Programa de Aceleración de mentorDay y convierte la teoría en acción.

👉 ¡Da el salto y acelera esta competencia con mentorDay! https://links.mentorday.es/inscripcion